La alianza estratégica entre Disney y OpenAI marca un antes y un después en la industria del entretenimiento, al abrir la posibilidad de que los fanáticos creen videos personalizados con más de doscientos personajes icónicos de Disney, Marvel, Pixar y Star Wars a través de Sora, la plataforma de generación de video mediante inteligencia artificial. Según el acuerdo, una selección de estas creaciones podría aparecer en Disney+ a partir del próximo año, lo que representa un nuevo modelo de interacción entre audiencia, tecnología y propiedad intelectual.

La colaboración busca transformar la forma en que los usuarios participan en los universos narrativos de Disney, al tiempo que posiciona a la compañía como una de las primeras grandes productoras de Hollywood en adoptar abiertamente la inteligencia artificial generativa para ampliar sus experiencias de contenido. OpenAI destacó que la lista de personajes disponibles incluye figuras tan emblemáticas como Mickey Mouse, Iron Man, Darth Vader, Elsa, Black Panther, Groot, Luke Skywalker, Yoda, Baymax y Simba, entre muchos otros.

Además, Disney se convertirá en un cliente principal de OpenAI, utilizando sus herramientas para desarrollar nuevos productos digitales, optimizar experiencias en Disney+ y explorar aplicaciones en otras áreas del conglomerado, desde parques temáticos hasta licencias y merchandising.

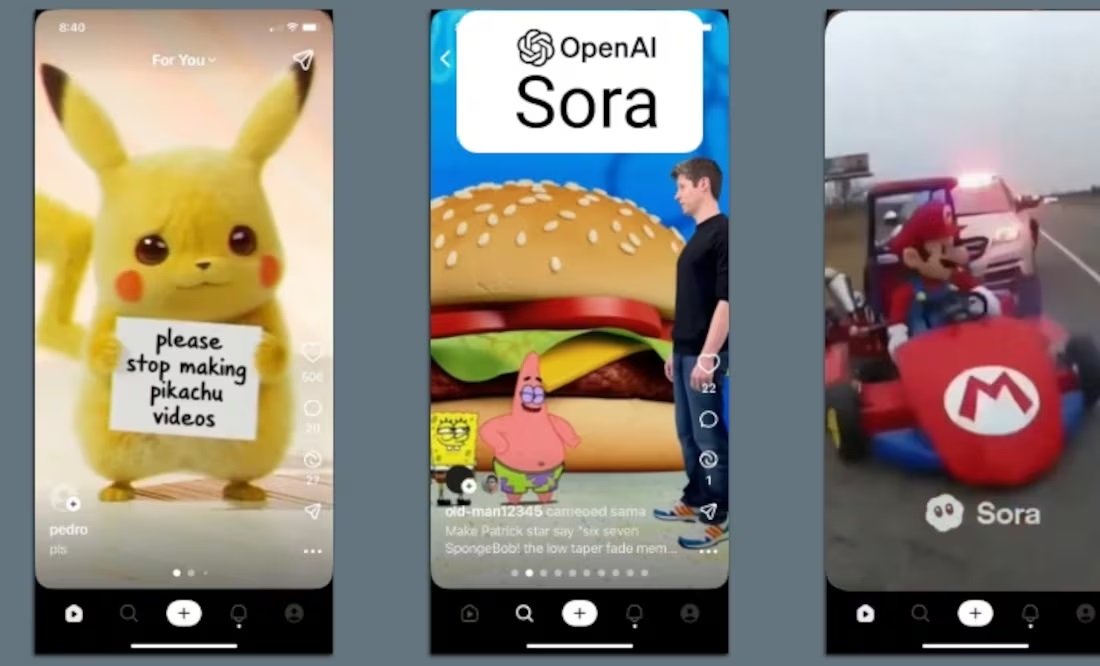

Este anuncio representa un cambio de paradigma para la industria del entretenimiento, que hasta hace poco mostraba resistencia al uso de IA generativa, especialmente después de la controversia surgida con el lanzamiento inicial de Sora, cuando la plataforma permitía crear videos con la imagen de celebridades sin autorización. Incluso agencias de talentos como WME, CAA y UTA criticaron abiertamente el modelo.

Con este convenio, Disney busca monetizar su propiedad intelectual de manera regulada y evitar que terceros utilicen sus personajes sin control, a la vez que se adapta al cambiante consumo digital de generaciones como la Gen Z y la Generación Alfa. La estrategia recuerda a la inversión de 1,500 millones de dólares en Epic Games, destinada a integrar sus personajes en Fortnite y ampliar su presencia en ecosistemas digitales populares.

El director ejecutivo de Disney, Bob Iger, resaltó que la inteligencia artificial representa un momento crucial para el sector y afirmó que la empresa trabajará “de manera reflexiva y responsable” con OpenAI para expandir el alcance de sus historias, protegiendo siempre los derechos de los creadores. Por su parte, Sam Altman, CEO de OpenAI, subrayó que Disney es el “estándar global en narrativa” y expresó entusiasmo por colaborar en nuevas formas de creación y disfrute de contenido.

Con esta alianza, Disney busca consolidarse como líder en innovación tecnológica mientras la industria observa con atención el impacto que la inteligencia artificial tendrá en la creación, distribución y monetización de contenidos en los próximos años.